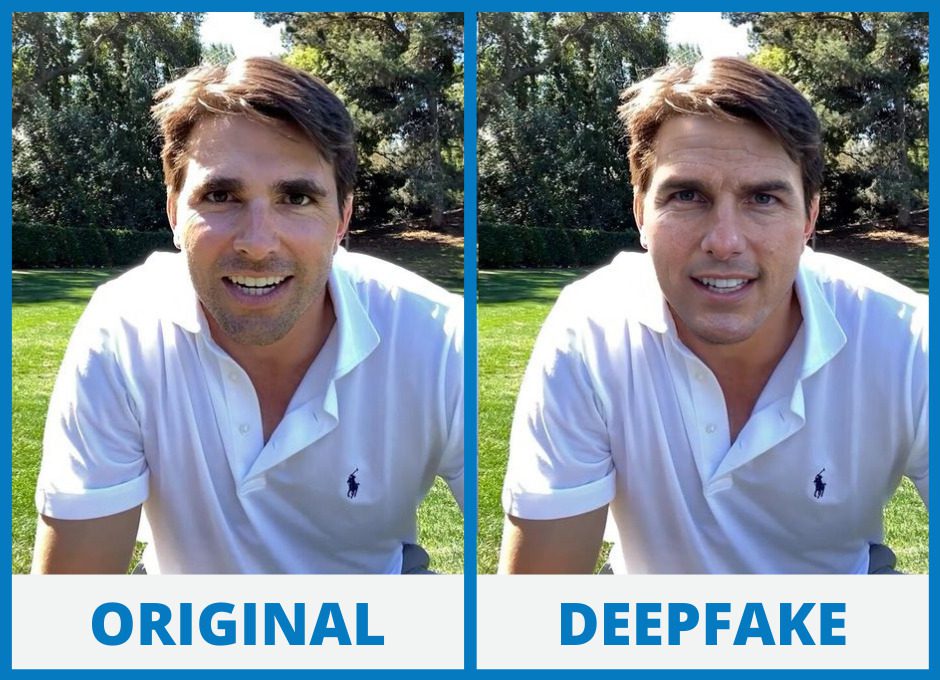

Deepfake生成图像的迹象过去很容易被发现,但生成式人工智能让我们质疑我们现在所见所闻的一切,随着每一个新的 AI 模型的发布,你现在可以在几秒钟内创建 deepfake 视频、你所爱之人的声音以及伪造文章。

为了避免被 AI deepfakes 技术愚弄,有必要了解它们会带来什么样的危险。

Deepfake 显示一个人正在做现实生活中从未发生过的事情。这完全是假的。

1. 人工智能身份盗窃

你可能见过他们。在世界范围内第一批真正病毒式传播的 AI deepfakes 包括特朗普被捕的照片,以及身穿白色羽绒服的教皇方济各的照片。

虽然这似乎是对一位著名的宗教人物在罗马寒冷的日子里可能会穿什么的天真无邪的重新想象;另一张图片显示的是一名政治人物在严重的违法情况下被捕,如果被认为是真实的,后果会严重得多。

不幸的是,作为一个普通的、不知名的人也不能保证你不会受到 AI deepfakes 的侵害。

如果其他人用你的照片做这个,危险可能比穿白夹克的教皇的深度伪造图像要大得多——他们可以在任何地方使用它,假装是你。虽然大多数人通常出于善意使用人工智能,但很少有限制阻止人们使用它造成伤害,尤其是在身份盗用的情况下。

2. Deepfake 语音克隆诈骗

在 AI 的帮助下,deepfakes 跨越了我们大多数人都没有准备好的界限:假声音克隆。只需少量原始音频——可能来自你曾经发布的 TikTok 视频,或者你出现在其中的 YouTube 视频——人工智能模型就可以复制你独一无二的声音。

想象一下接到一个听起来就像家人、朋友或同事的电话,既不可思议又令人恐惧。Deepfake 语音克隆是一个非常严重的问题,联邦贸易委员会 (FTC)已就此发出警告。

面临风险的不仅仅是老一代,卫报报道了另一个例子,一位银行经理在他们认为是银行董事的人发出一系列“伪造的电话”后批准了一笔 3500 万美元的交易。

3.大量生产的假新闻

传播错误信息当然不是什么新鲜事,但2023 年 1 月在 arXiv 上发表的一篇研究论文解释说,问题在于使用 AI 工具扩大输出是多么容易。他们将其称为“人工智能产生的影响力运动”,他们说,例如,政治家可以利用它来外包他们的政治运动。

创建 deepfake 就像下载应用程序一样简单。人们可以使用 TokkingHeads 之类的应用程序将静止图像转换为动画化身,这样人们就可以上传自己的图像和音频,使人看起来就像在说话。

在大多数情况下,它既生动又有趣,但也有潜在的麻烦。它向我们展示了使用任何人的形象是多么容易,使它看起来好像那个人说出了他们从未说过的话。

随着大量 AI 应用程序的出现,几乎任何人都可以使用用于创建 Deepfake 的工具。随着 AI deepfake 技术变得越来越先进,值得密切关注它带来的危险。